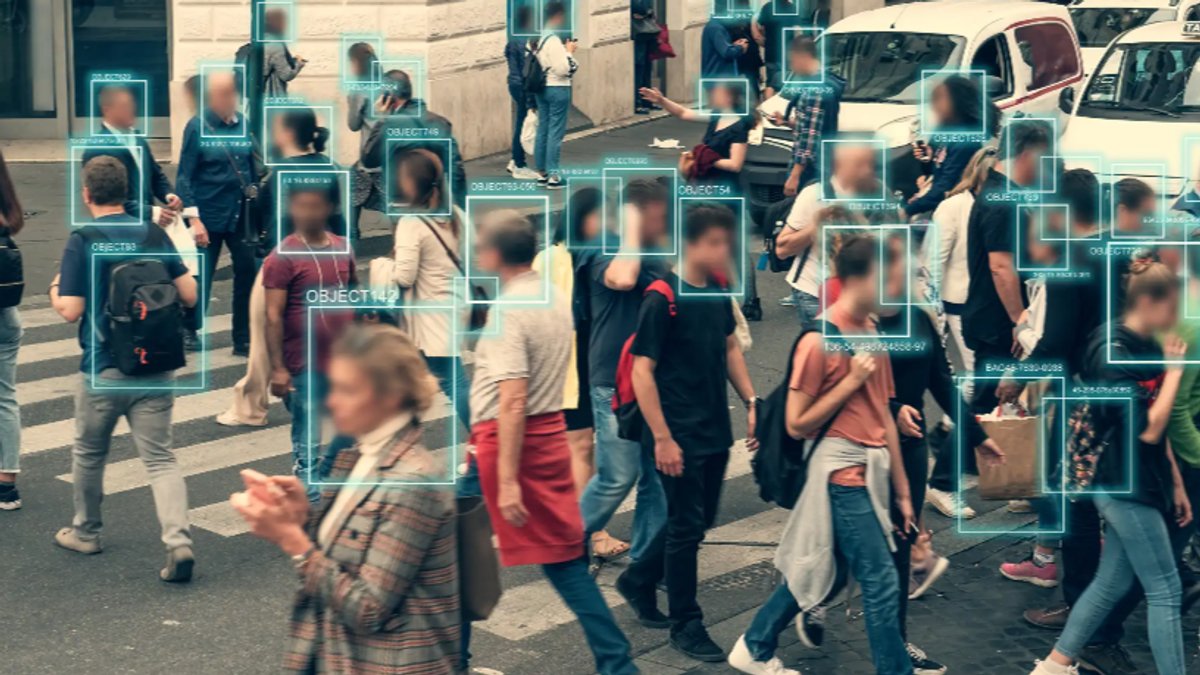

De regering-De Wever zet de deur open voor het gebruik van gezichtsherkenning met AI, een feilbare technologie met grote consequenties.

Op 2 februari trad een deel van de AI-act in werking, dat is de Europese verordening over artificiële intelligentie. In deze verordening worden AI-systemen onderverdeeld in verschillende risicocategorieën. Afhankelijk van de categorie waarin een AI-systeem valt, gelden striktere of lossere regels. Zo valt het real-time gebruik van gezichtsherkenningstechnologie in de openbare ruimte onder de categorie van de verboden praktijken, maar staat het de lidstaten vrij om hierop uitzonderingen te maken.

Een aandachtige lezing van het regeerakkoord-De Wever I maakt duidelijk dat deze regering de bedoeling heeft om gebruik te maken van de mogelijkheid om uitzonderingen op het verbod te voorzien. Er wordt immers hoog ingezet op de veiligheid van onze samenleving. Maar liefst 265 keer komt dit woord voor in de tekst van het akkoord.

Het spreekt voor zich dat de Liga voor Mensenrechten ijvert voor een veilige samenleving voor iedereen. Dit mag echter niet ten koste gaan van onze fundamentele rechten. Het recht op privacy is één van de meest fundamentele rechten die we hebben. Dat recht opgeven om de veiligheid te verzekeren, vraagt dan ook een zeer grondig debat waarin alle pro’s en contra’s aan bod komen. De Liga voor Mensenrechten is om meerdere redenen geen voorstander van het voorzien van uitzonderingen op het totaal verbod op het gebruik van gelaatsherkenningstechnologieën.

VAAGHEID VAN DE BEGRIPPEN

Volgens de AI-act zouden deze technologieën wel kunnen worden toegelaten ter preventie van een terreuraanslag of het opsporen van een verdachte van strafbare feiten, zoals milieucriminaliteit of sabotage. Op het eerste zicht zeer legitieme redenen, maar het gevaar schuilt – zoals zo vaak – in de vaagheid van deze begrippen. Zo omvat de definitie van ‘milieucriminaliteit’ zowel grootschalige illegale praktijken als kleine overtredingen, zoals sluikstorten. Bij sommige politici lijkt de wens om gezichtsherkenning zelfs voor kleine vergrijpen in te zetten duidelijk aanwezig. Zo opperde Vooruit-voorzitter Conner Rousseau onlangs nog om gezichtsherkenning in te zetten als maatregel tegen sluikstorten.

Conner Rousseau opperde onlangs nog om gezichtsherkenning in te zetten als maatregel tegen sluikstorten.

Ook bij het misdrijf terrorisme bestaat een reëel risico op disproportionele verschuivingen. In aanloop naar de verkiezingen riep Vlaams Belang op om bewegingen zoals Black Lives Matters en Exctintion Rebellion toe te voegen aan de Belgische lijst van terreurorganisaties. Daarbij baart de groeiende criminalisering van het recht op protest en acties van burgerlijke ongehoorzaamheid ons in deze context zorgen.

Uitzonderingsgronden moeten dus kritisch worden benaderd. De definities van deze misdrijven zijn immers rekbaar. Ze bieden zelden een solide kader dat een beperkt gebruik van gezichtsherkenning zou toelaten.

FEILBARE TECHNOLOGIE MET GROTE CONSEQUENTIES

De doeltreffendheid van gezichtsherkenningstechnologie is relatief, omdat ze gepaard gaat met fouten en misbruik. In het Verenigd Koninkrijk wordt gezichtsherkenning sinds 2016 gebruikt. Drie jaar later bleek uit een eerste onafhankelijk onderzoek van de Universiteit van Essex naar het gebruik van gezichtsherkenning door de Londense politie dat 80% van de verdachten die door gezichtsherkenningssoftware werden gemarkeerd onschuldig waren. Aan de hand van het systeem werden regelmatig personen ten onrechte geïdentificeerd, met alle mogelijke sociale en juridische gevolgen van dien.

De vraag is of foutenmarges, zelfs al zouden die verkleinen in de toekomst, ooit gerechtvaardigd zijn gelet op de verregaande gevolgen voor betrokken individuen.

De impact van gezichtsherkenningstechnologie zal ongetwijfeld groter zijn bij groepen die vandaag al vaker geviseerd en geprofileerd worden.

Bovendien staat vast dat die gevolgen vooral kwetsbare groepen zal treffen. Eén van de meest problematische aspecten van gezichtsherkenning is de kans op een discriminerend effect aangezien de meeste software aanvankelijk ‘gevoed’ werd met gegevens die niet representatief zijn voor de gehele samenleving. Bovendien zal de impact van gezichtsherkenningstechnologie ongetwijfeld groter zijn bij groepen in onze samenleving die vandaag al vaker geviseerd en geprofileerd worden. Meer specifiek zijn dit mensen op de vlucht, mensen van de LGBTQI+-gemeenschap, geracialiseerde minderheden, daklozen en iedereen die afwijkt van de norm.

ONOMKEERBARE DREIGING VOOR DE TOEKOMST

Gefilmd en gecontroleerd worden in de openbare ruimte is een inbreuk op de privacy en de individuele vrijheid. Het heeft een weerslag op de manier waarop we ons gedragen, uitdrukken, bewegen in de openbare ruimte. De dreiging en angst die surveillance met zich meebrengen, kan gedrag afremmen. En dus een chilling effect creëren. Bovendien moeten we een uitbreiding van surveillancetechnologie ook beoordelen in het licht van politieke ontwikkelingen. Radicale en autoritaire partijen winnen terrein, in de hele wereld, maar ook bij ons. De vraag is wat er met deze technologieën gebeurt als ze in handen vallen van een dergelijk regime. De geschiedenis toont immers aan dat eens een surveillance-infrastructuur is opgezet, deze moeilijk terug te draaien is.

In China wenden de autoriteiten gezichtsherkenning geregeld aan als een sociaal controlemiddel. Volgens de Amerikaanse krant Wired zou Iran gezichtsherkenning gebruiken om vrouwen te identificeren die in opstand komen tegen de autoriteiten en die niet langer een sluier willen dragen. Rusland focust ook op de tegenstanders van de oorlog tegen Oekraïne.

In Brussel werden camera’s geplaatst in de strijd tegen terrorisme, maar momenteel gebruikt om toe te zien op de lage-emissiezone.

In België is de situatie nog niet zo verregaand. Toch worden bewakingstechnologieën steeds breder verspreid en steeds vaker toegepast in situaties waarvoor ze oorspronkelijk niet waren bedoeld. Zo werden bewakingscamera’s in de Joodse wijk van Antwerpen geïnstalleerd om een terroristische aanslag te voorkomen. Deze werden later door de politie aangewend om na te gaan of de coronamaatregelen in dezelfde wijk werden nageleefd. Ook in het Brussels Hoofdstedelijk Gewest werden deze camera’s geplaatst in de strijd tegen terrorisme, maar worden ze momenteel gebruikt om toe te zien op de lage-emissiezone. Vandaag dienen de camera’s voornamelijk om verkeersinbreuken te detecteren. Het gebruik van gelaatsherkenningstechnieken maakt het risico van een function creep alleen maar erger.

OPROEP TOT DEMOCRATISCH DEBAT

De AI Act laat toe dat lidstaten gezichtsherkenning strenger regelen, inclusief verbieden zonder uitzonderingen. Onlangs waarschuwde ook KULeuven-onderzoekster Sofie Royer voor overhaaste beslissingen en het belang van een breed maatschappelijk debat.

De Liga voor Mensenrechten en de Ligue des Droits Humains roepen het federaal parlement op om een dergelijk democratisch debat te voorzien. Hierbij moeten specialisten, maar ook het middenveld en de gemeenschappen die door surveillancetechnologieën worden getroffen, betrokken worden om de vele inherente gevaren van deze systemen bloot te leggen. Enkel zo kan men garanderen dat technologie wordt ingezet in dienst van mensen en hun rechten, eerder dan tegen hen.